Runway AI社が提供する動画生成AI「Runway Gen-3」は、クリエイティブな動画制作を加速させるツールです。

高品質な動画生成能力や直感的な操作性で、クリエイターやビジネスパーソンの注目を集めています。クリエイターやマーケターの間で急速に注目を集めています。

本記事では、前バージョンであるRunway Gen-2との違いや、Runway Gen-3の特徴、そしてその使い方までをわかりやすく紹介しますので、是非最後までご覧ください。

目次

|Runway Gen-3とは?

Runway Gen-3は、Runway社が開発した最新の動画生成AIモデルです。

テキストプロンプトから高品質な動画を生成する能力を持ち、クリエイティブな表現の幅を大きく広げることが期待されています。

ユーザーはテキストで入力したプロンプトをもとにAIが映像を作り上げるため、複雑な技術的スキルを必要とせず、クリエイティブな発想をそのまま映像に反映できます。

そのため、プロのクリエイターはもちろん、初心者でも簡単に高品質な映像制作が可能です。

Runway Gen-2との比較

Runway Gen-3は、前モデルであるRunway Gen-2と比較して、いくつかの重要な改良点があります。

画質と一貫性の向上:Gen-3は、Gen-2に比べて動画の画質や一貫性が大幅に向上しています。

特に複雑な動きやリアルな人物の動作を精緻に再現する能力に優れています。

動画の長さ:Gen-3では5秒または10秒の動画生成が可能になりました。

Gen-2の最大16秒と比べると短くなっていますが、より高品質な動画を生成できるようになっています。

生成方法:現時点でGen-3はテキストから動画を生成する機能(Text to Video)のみに対応しています。

一方、Gen-2では画像やビデオクリップからも動画を生成できました。

機能の進化:Gen-3では、詳細なアートディレクション機能や改良されたMotion Brush機能が導入されています。

これにより、より複雑なシーンやシネマティックな動きを生成できるようになりました。

生成速度:Gen-3は5秒の動画を生成するのに約45秒、10秒の動画を生成するのに約90秒かかります。

これはGen-2よりも時間がかかっていますが、生成品質の向上を考慮すると妥当な時間と言えます。

安全対策:Gen-3では、改良された視覚的モデレーションシステムやC2PA証明標準が導入され、より安全な利用が可能になっています。

Runway Gen-3はGen-2の基本的な機能を継承しつつ、画質や表現力、安全性などの面で大幅にアップデートされています。

|Runway Gen-3の主な特徴

ここでは、Runway Gen-3の主な特徴をいくつかご紹介します。

高品質な動画生成能力

Runway Gen-3は、前モデルのGen-2と比較して画質や一貫性が大幅に向上しています。

特に複雑な動きやリアルな人物の動作を精緻に再現する能力に優れています。

生成される動画の解像度は720p (1280×768)となっており、鮮明で滑らかな高品質な動画を生成できます。

改良されたMotion Brush機能

Motion Brush機能は、画面内の特定の箇所に動きを付加する機能です。

Gen-3では、この機能がさらに改良され、より複雑なシーンやシネマティックな動きを生成できるようになりました。

静止画の特定部分に自然な動きを加えることができ、よりダイナミックな映像を作成できます。

詳細なアートディレクション機能

Gen-3では、詳細なアートディレクション機能が導入されています。

これにより、ユーザーは動画の細部を細かく制御できるようになりました。

カメラワークや照明、構図などの指示をプロンプトに含めることで、より具体的なビジュアルや機能を正確に具現化することができます。

リップシンク機能

Gen-3には、リップシンク機能が搭載されています。

この機能により、生成された人物キャラクターの口の動きを音声に合わせて自然に動かすことができます。

これにより、より現実的で説得力のある動画を作成することが可能になりました。

Image to Video機能

Image to Video機能は、静止画から動画を生成する機能です。

Gen-3では、この機能が強化され、より高品質な動画生成が可能になりました。

ユーザーは静止画とプロンプトを組み合わせることで、その画像を起点とした動画を生成することができます。

|Runway Gen-3の使い方

Runway Gen-3は、初心者でも簡単に扱える直感的なインターフェースを備えていますが、プロフェッショナルな映像制作を目指すためには、基本的な操作方法を理解することが重要です。

以下では、Runway Gen-3のはじめ方と基本的な使い方について解説します。

はじめ方

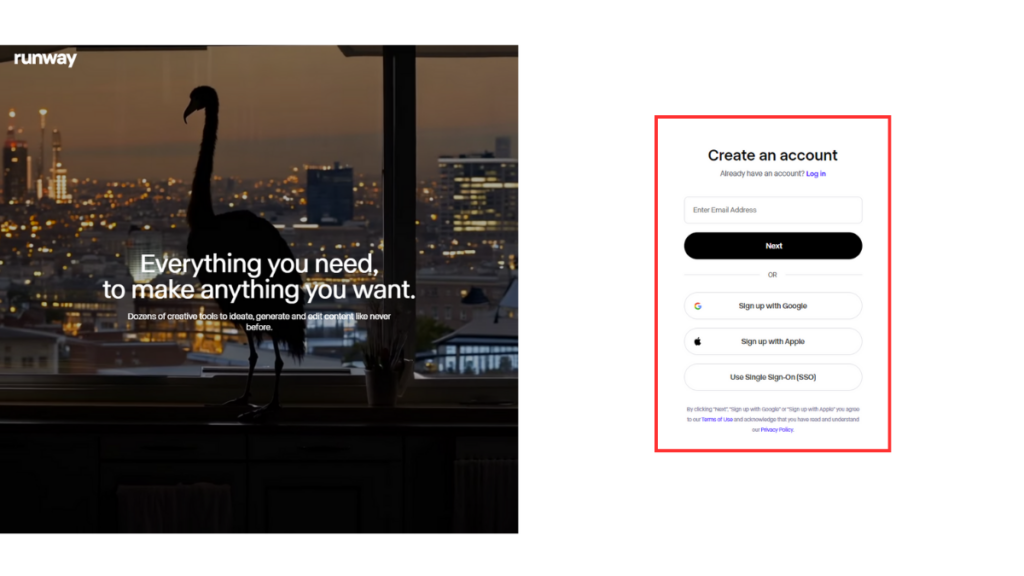

まず、公式サイトにアクセスして、アカウント作成を行います。

画面右側のフォームからメールアドレスを登録するか、Googleアカウント/appleアカウント/SSOいずれかでログインするか選択できます。

これでアカウン登録は完了です!

使い方

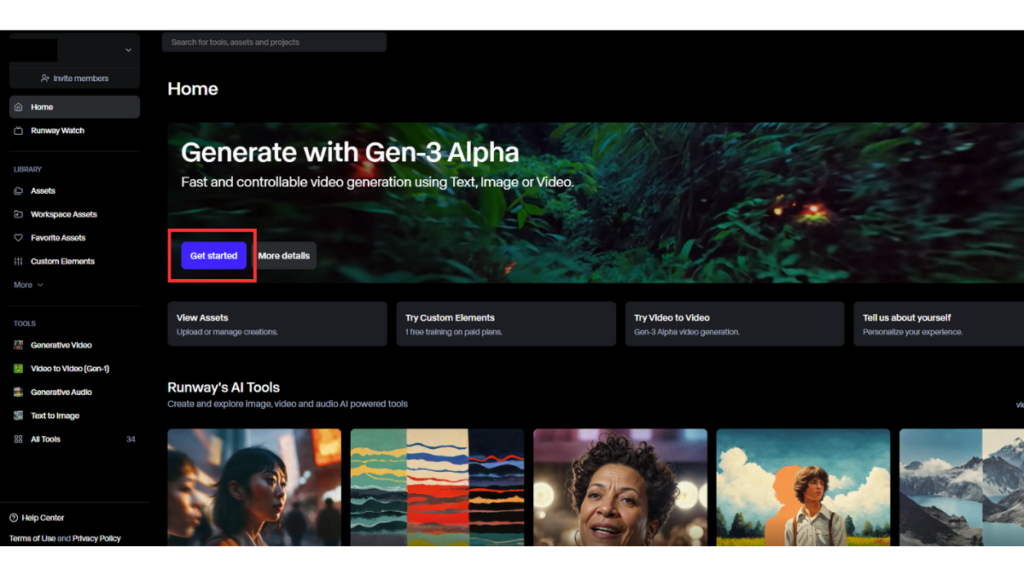

ログインができたら下記のような画面になるので、「Get started」をクリックします。

すると、下記のような動画生成画面に遷移します。

(2024年10月現在はGen-3 Alpha Turboモードが使用可能です)

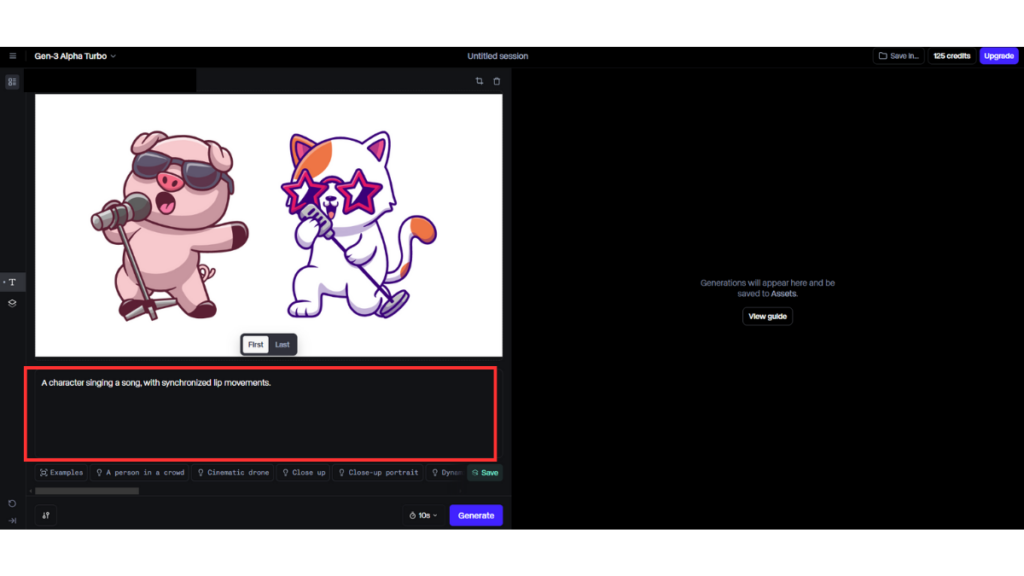

赤枠部分にテキストプロンプトを入力して、その上にイメージ画像を添付するだけで、動画生成が可能です。

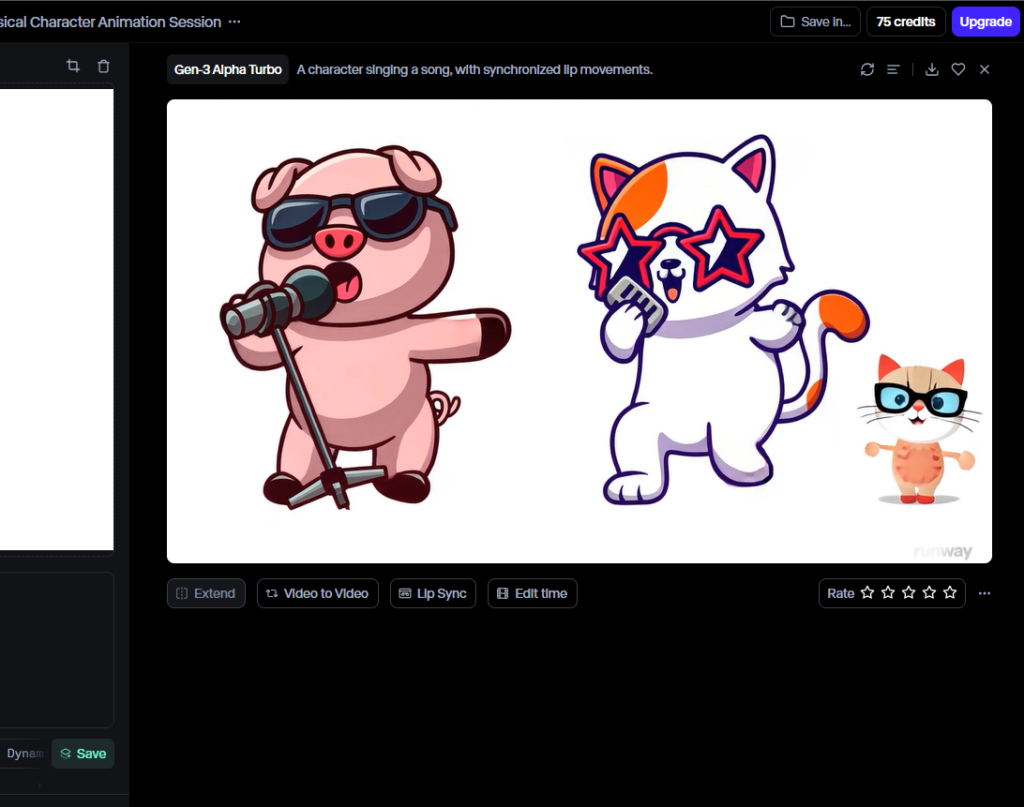

例えば、「A character singing a song, with synchronized lip movements.(歌を歌うキャラクターと、それに合わせた口の動きがシンクロしている)」と入力し、「Generate」をクリックします。

すると、画面右側に、AIが自動生成した動画のプレビューが流れます。

生成した動画は、画面右上のDLボタンから保存できます。

さらに、アートディレクション機能やMotion Brushを使って、細かい部分の調整を行い、自分のビジョンに合った映像を作り上げましょう。

↓実際に作成した動画

|プロンプト入力のコツ

Runway Gen-3を使用する際に、効果的なプロンプトを作成することは、生成される動画の質を大きく左右します。

以下に、プロンプト入力のコツをご紹介します。

具体的で明確な指示を与える

プロンプトを入力する際は、曖昧な表現を避け、できるだけ具体的な指示を与えることが重要です。

例えば、「美しい風景」ではなく、「雪が積もった山々と青空が広がる風景」のように、シーンの詳細を明確に記述することで、AIはより精度の高い映像を生成します。

視覚的要素を意識する

映像は視覚的なメディアであるため、プロンプトには視覚的な要素を含めることが有効です。

例えば、色、ライティング、カメラアングルなどを指定すると、映像の雰囲気やスタイルをコントロールしやすくなります。

「夕日の中、逆光で映し出される人物」といった表現を用いると、特定の視覚効果を強調できます。

スタイルやムードの指示を加える

映像の全体的なスタイルやムードを指定することで、AIはその方向性に従って映像を作成します。

例えば、「ノスタルジックな色調」や「未来的なデザイン」といった言葉を追加することで、動画のトーンやテーマが明確になります。

これらのコツを参考にして、Runway Gen-3で効果的なプロンプトを作成し、高品質な動画生成に挑戦してみてください。

|まとめ

Runway Gen-3は、AIを活用した動画生成ツールとして、非常に高い性能と多機能性を兼ね備えています。

Runway Gen-2から大幅に改良された機能や新たに追加されたツールにより、動画制作のクオリティや効率が飛躍的に向上しました。

高品質な動画生成能力、Motion Brushやリップシンクといった強力なツール、さらにアートディレクション機能やImage to Video機能によって、クリエイターは自分のアイデアを細部にわたって表現することができます。

使い方もシンプルで、プロンプト入力のコツを押さえることで、思い通りの映像を実現することが可能です。

Runway Gen-3を活用することで、クリエイターはより効率的に、より創造的な作品を生み出すことができるでしょう。

今後もこの技術が進化し、さらなる機能追加や改善が期待されます。

TWITTER

TWITTER

FACEBOOK

FACEBOOK

はてブ

はてブ